Johdanto

Euroopan parlamentin julkaisema tekoälyasetus vaikuttaa tekoälyä hyödyntävien organisaatioiden toimintaan. Tavoitteena on varmistaa, että sisämarkkinoilla käytetyt tekoälyjärjestelmät ovat turvallisia ja kunnioittavat perusoikeuksia (Euroopan unionin neuvosto, 2022). Sääntelyn olemassaolo on hyvä tiedostaa myös tutkimus-, kehittämis- ja innovaatiotyötä (TKI) tekevien arjessa, vaikka asetus ei estäkään tekoälyinnovointia ja -kehittämistä TKI-toiminnassa. Käsittelemme aihetta TKI-työn ja EU-rahoituksen asiantuntijoina. Mielenkiintomme kohdistuu yleiseen tekoälyjärjestelmien kehittymiseen sekä tekoälyn tuottamiin mahdollisuuksiin ja rajoituksiin, jotka on huomioitava ammattikorkeakoulujen TKI-toiminnassa ja erityisesti TKI-rahoitushakemusten valmistelussa.

Tekoälyasetuksen voimaantulo ja seuraamukset

Euroopan parlamentti hyväksyi tekoälyasetuksen (EU AI Act) toukokuussa 2024 ja se astui voimaan EU:n jäsenvaltioissa 1.8.2024 (Euroopan Parlamentin ja Neuvoston Asetus 2024/1689). Asetus on ensimmäinen laatuaan ja sillä on maailmanlaajuisia vaikutuksia tekoälyn sääntelyyn sekä eurooppalaisten yritysten ja organisaatioiden toimintaan, jotka hyödyntävät ja käyttävät tekoälyä. Tekoälyasetus tulisi huomioida myös ammattikorkeakoulujen toiminnassa.

Aiheen ajankohtaisuutta korostaa kansallisella tasolla työ- ja elinkeinoministeriön (TEM) hiljattain käynnistämä tekoälyasetuksen kansallinen toimeenpanotyöryhmä. Työryhmän tehtävänä on arvioida, mitä kansallista lainsäädäntöä tekoälyasetus edellyttää sekä valmistella ehdotus tekoälyasetuksen kansallista täytäntöönpanoa koskevaksi lainsäädännöksi (Työ- ja elinkeinoministeriö, 2024).

Tekoälyjärjestelmiä käsiteltäessä on hyvä tarkentaa, mitä niillä tarkoitetaan. Tekoälyasetuksen mukaan tekoälyjärjestelmät määritellään niiden keskeisten ominaisuuksien perusteella. Yhtenä tärkeimmistä ominaisuuksista mainitaan järjestelmän päättelykyky, jolla tarkoitetaan tekoälyn kykyä käsitellä tietoa ja tehdä johtopäätöksiä. Tekoälyjärjestelmä voi sisältää myös eriasteista itseohjautuvuutta sekä itseoppimiskyvyn, jonka avulla järjestelmä voi muuttua käytön aikana. (EU:n tekoälyasetus 2024/1689; §12.) Usein tekoälystä puhuttaessa tarkoitetaan generatiivista tekoälyä (esim. ChatGPT), jonka tarkoitus on tuottaa sisältöä, kuten tekstiä, kuvia, videoita tai ääntä (Kallio, 2024).

Tekoälyasetus otetaan käyttöön vaiheittain kahden vuoden sisällä sen voimaantulosta tietyin poikkeuksin. Alla on listattu keskeisimpiä käyttöönoton vaiheita, joissa on otettu kantaa eri riskitason tekoälyjärjestelmiin:

- 6 kuukautta: kiellot tulevat voimaan ja jäsenvaltioiden on poistettava käytöstä kielletyt järjestelmät

- 12 kuukautta: velvoitteet yleiskäyttöisten tekoälyjärjestelmien (General Purpose AI models, GPAI), läpinäkyvyysvaatimuksista tulevat voimaan. Seuraamuksia koskevat säännökset astuvat voimaan

- 24 kuukautta: suurin osa tekoälylain säädöksistä tulee voimaan

- 36 kuukautta: tiettyihin korkean riskin tekoälyjärjestelmiin liittyvä sääntely tulee voimaan (European Union 2024a).

Tarkemmin aikataulua on havainnollistettu mm. Hickmanin ym. (2024) artikkelissa ”Long awaited EU AI Act becomes law after publication in the EU’s Official Journal”.

Tekoälylain rikkomisesta määrättävät sakot vaihtelevat yrityksen tai organisaation edellisen tilikauden vuotuisen liikevaihdon mukaan, sakkojen määrään vaikuttaa myös rikkomuksen merkittävyys. Korkeimmillaan sakon suuruus voi olla jopa 35 miljoonaa euroa tai 7 % edellisen vuoden liikevaihdosta sen mukaan kumpi on korkeampi. Esimerkiksi virheellisen, puutteellisen tai harhaanjohtavan tiedon toimittamisesta mm. kansallisille toimivaltaisille viranomaisille voi aiheuttaa jopa 7,5 miljoonan euron sakot. (European Commission, 2024a; XII luku 99 artikla.)

TKI-toiminnan ja rahoitushakemusten kannalta hyvä uutinen on, että asetusta ei sovelleta tekoälyjärjestelmiin, jotka on kehitetty ja otettu käyttöön yksinomaan tieteellistä tutkimusta ja kehittämistoimintaa varten. Asetus ei myöskään saa vaikuttaa tekoälyjärjestelmiä ja -malleja koskevaan tieteelliseen tutkimukseen ja kehittämistoimintaan ennen niiden markkinoille saattamista tai käyttöönottoa. (§ 25.)

Euroopan tason ohjeistusta tekoälyn hyödyntämiseen TKI-toiminnassa

Tekoälyasetuksen ohella Euroopan komissio ja muut Euroopan Unionin toimielimet pyrkivät mahdollistamaan ja ohjeistamaan toimijoita tekoälyn vastuullisesta käytöstä TKI-työssä (European Commission, 2024f). Euroopan komissio yhdessä Euroopan tutkimusalueen (ERA) maiden kanssa julkaisi maaliskuussa 2024 ohjeita tekoälyn vastuullisesta käytöstä tutkimuksessa. Euroopan komission ja ERA:n ohjeistus käsittelee tekoälyn hyödyntämisen keskeisiä mahdollisuuksia ja haasteita. Ohjeistus perustuu tutkimuseettisille periaatteille ja tarjoaa ohjausta tutkijoille, tutkimusorganisaatioille ja rahoittajille varmistaen yhtenäisen eurooppalaisen lähestymistavan. Vastuu tutkimuksesta ja tuloksista on aina ihmisten käsissä. Vaikka tekoälytyökalut tarjoavat nopeutta ja kätevyyttä tekstin, kuvien ja koodin tuottamisessa, on tutkijoiden, kehittäjien ja asiantuntijoiden oltava tietoisia teknologian rajoituksista, kuten plagiointiriskistä, arkaluontoisten tietojen paljastumisesta ja mallien sisäänrakennetuista vinoumista ja tutkimuksen eettisyydestä. (European Commission, 2024g, 6-10.)

Vastuu tutkimuksesta ja tuloksista on aina ihmisten käsissä.

Euroopan komission ja ERA:n keskeiset suositukset tekoälyn vastuullisesta käytöstä tutkimuksessa sisältävät seuraavat vastuualueet (European Commission, 2024g, 6-10):

Tutkijan vastuut:

- Tekoälyä käytettäessä noudatetaan tutkimuseettisiä periaatteita ja kannetaan lopullinen vastuu tieteellisestä tuotoksesta.

- Tekoälyä käytettäessä säilytetään yksityisyyden suoja, luottamuksellisuus ja immateriaalioikeudet niin tutkimusta toteuttaessa ja kuin tuloksissa.

- Säilytetään kriittinen lähestymistapa tekoälyn käyttöön ja yllä pidetään osaamistaan tekoälyn lukutaidossa ja vastuullisessa käytössä.

- Vältetään tekoälytyökalujen käyttöä sensitiivisen tiedon käsittelyssä, vertaisarvioinneissa tai tekstin arvioinneissa.

Tutkimusorganisaatioiden vastuut:

- Ohjeistetaan tekoälytyökalujen vastuullisessa käytössä sekä aktiivisesti valvotaan tekoälytyökalujen kehittymistä ja niiden käyttöä

- Integroidaan ohjeet osaksi organisaation toimintaa sekä muutetaan ja laajennetaan ohjeita tarvittaessa

- Otetaan käyttöön omia tekoälytyökaluja tietosuojan ja luottamuksellisuuden varmistamiseksi

Rahoitusorganisaatioiden vastuut:

- Tuetaan tekoälyn vastuullista käyttöä tutkimuksessa

- Käytetään tekoälyä läpinäkyvisti luottamuksen ja rehellisyyden nimissä

- Helpotetaan tekoälyn läpinäkyvää käyttöä rahoitushakemusten valmistelussa

Luotettavan tekoälyn rakentaminen riskiarvioinnin pohjalle

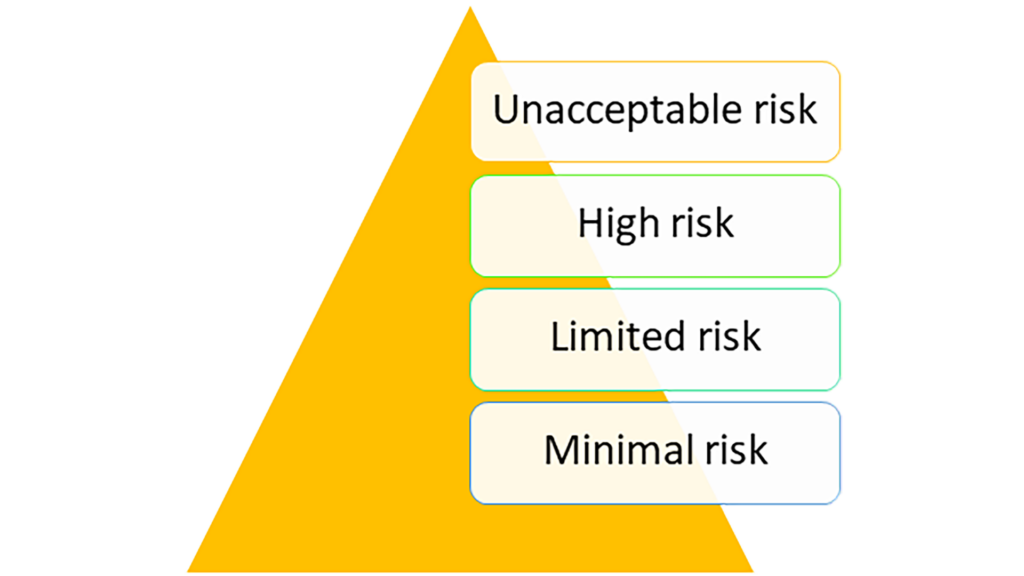

Mihin sitten EU:n tekoälyasetusta tarvitaan? Komission verkkosivujen mukaan tekoälyasetuksen tarkoituksena on luoda yhtenäinen ja selkeä oikeudellinen kehys tekoälyjärjestelmien kehittämiseen, markkinoille saattamiseen, käyttöönottoon ja käyttöön EU:ssa. Tavoitteena on edistää luotettavaa ja vastuullista tekoälyä Euroopassa ja ulkopuolella. Säädös edellyttää tekoälytyyppien luokittelua niiden aiheuttamien riskien perusteella. Luokittelu määrittelee velvollisuudet palvelun tarjoajille ja käyttäjille tekoälyn aiheuttamattoman riskitason mukaan. (European Commission, 2024b; European Parliament, 2023.)

Kuvan 1. mukaisesti riskitasot on jaettu neljään luokaan: ei-hyväksyttäviin, suuriin, vähäisiin ja olemattomiin riskeihin.

Ei-hyväksyttävät riskit (Unacceptable risk) ovat kiellettyjä, koska niiden katsotaan uhkaavan ihmisten turvallisuutta, oikeuksia tai toimeentuloa. Kiellettyjen järjestelmien listalla ovat mm. kognitiivinen käyttäytymismanipulaatio sekä sosiaalinen pisteytys ja profilointi rodun, uskonnon tai seksuaalisen suuntautumisen perusteella.

Suuren riskin (High risk) tekoälyjärjestelmien katsotaan vaikuttavan kielteisesti turvallisuuteen ja ihmisten perusoikeuksiin. Yksi, erityisesti yleissivistävässä ja ammatillisessa koulutuksessa huomioitava korkean riskin käyttötapaus liittyy oppimistulosten arviointiin ja oppimisprosessin ohjaukseen sekä vilpin valvontaan (§56). Korkean riskiluokituksen saaneita tekoälyjärjestelmiä on arvioitava ennen EU:n markkinoille pääsyä ja koko niiden elinkaaren ajan. Nämä järjestelmät sekä tietyt korkean riskin tekoälyjärjestelmän käyttäjät on rekisteröitävä EU:n korkean riskin tekoälyjärjestelmien tietokantaan. Tunnetilojen tunnistusjärjestelmien käyttäjien on ilmoitettava käyttäjille altistuksesta tällaiselle järjestelmälle. Lisäksi suurriskisten järjestelmien kyberturvallisuuden taso on varmistettava mm. turvallisuustarkastusten muodossa (§76).

Vähäisten (Limited) ja olemattomien (Minimal) riskien osalta säädös antaa mahdollisuuden tekoälyn vapaalle käytölle. Järjestelmiltä edellytetään kuitenkin läpinäkyvyysvelvoitteiden noudattamista. Tämä tarkoittaa mm. käyttäjän tiedottamista siitä, kun hän on vuorovaikutuksessa koneen kanssa (esim. chatbot). Myös syväväärennökset (deep fakes), jotka ovat tekoälyn avulla tuotettua tai muokattua kuvaa, ääntä tai videota, on selkeästi merkittävä tekoälyn tuottamaksi (§134). Suurin osa EU:ssa käytössä olevista järjestelmistä kuuluu vähäisten riskien luokkaan, kuten generatiivista tekoälyä hyödyntävä ChatGPT. On kuitenkin huomioitava, että suurella laskentateholla koulutetut tekoälymallit saattavat aiheuttaa systeemistä riskiä ja joutuvat siksi mahdollisesti läpikäymään perusteellisemman arvioinnin. Tästä esimerkkinä edistyneempi tekoälymalli GPT-4. (European Parliament, 2023; §111–115.)

Tekoälyinnovaatioiden kiihdyttäminen ja tukitoiminnot

EU:n tekoälysääntelyn tavoitteena ei ole ainoastaan rajoittaa tekoälyjärjestelmien markkinoille tuloa, vaan tarjota tukea erityisesti uusille pk-yrityksille ja kasvuvaiheen pk-yrityksille innovaatioiden kiihdyttämiseen ns. tekoälyinnovaatiopaketin kautta. Asetus velvoittaa kansallisia viranomaisia tarjoamaan startupeille ja pk-yrityksille vähintään yhden tekoälyn sääntelyn testiympäristön, joka on oltava toiminnassa kahden vuoden sisällä (§138). Suomessa kansallisella tasolla tämä ympäristö on osa TEM:n toimeenpanotyöryhmän selvitystyötä.

Tekoälyinnovaatiopaketti mahdollistaa muun muassa supertietokoneiden hankintaa ja niiden päivittämistä sekä tarjoamista eurooppalaisten startupien saataville tekoälymallien kouluttamiseksi. Lisäksi se mahdollistaa tekoälykyvykkyyden vahvistamisen koulutuksen avulla sekä yhteisten eurooppalaisten datatilojen kehittämisen ja käyttöönoton kiihdyttämisen. Rahoituskanavina toimivat muun muassa Horizon Europe ja Digital Europe rahoituskanavat. (European Commission, 2024e.)

Tekoälyinnovaatiopakettiin kuuluu niin sanottu GenAI4EU-aloite. Aloitteen tavoitteena on edistää uusien käyttötapojen ja nousevien sovellusten kehittämistä Euroopan 14 teollisessa ekosysteemissä sekä julkisella sektorilla. Sovellusalueina ovat robotiikka, terveys, bioteknologia, valmistus, liikkuvuus, ilmasto ja virtuaalimaailmat. (European Commission, 2024d.)

Tekoälyinnovaationpaketin osana ja tekoälylainsäädännön tueksi on perustettu myös Euroopan tekoälytoimisto (AI Office). Toimiston tarkoitus on varmistaa tekoälypolitiikan kehittäminen ja koordinointi sekä valvoa tekoälylain täytäntöönpanoa. Tämän lisäksi on perustettu muita hallintoelimiä, kuten riippumattomista asiantuntijoista koostuva tiedelautakunta tukemaan valvontatoimia ja tekoälyneuvosto tukemaan komissiota ja jäsenvaltioita. Neuvoa-antava foorumi muodostuu sidosryhmäasiantuntijoista. (European Commission, 2024d; §149–151.)

Kaiken tämän lisäksi on perustettu AI Pact, eli tekoälysopimus. Sen tarkoitus on kannustaa ja tukea yrityksiä ja organisaatioita valmistautumaan etukäteen asetuksen toimenpiteiden toteuttamiseen. Sopimuksen tavoitteena on luoda yhteisö, jossa osallistujat voivat jakaa kokemuksiaan ja tietämystään. Tämä sisältää tekoälytoimiston järjestämiä työpajoja, jotka tarjoavat osallistujille paremman ymmärryksen asetuksesta, heidän vastuistaan ja siitä, miten valmistautua asetuksen toteuttamiseen. (European Commission, 2024c.)

Tekoälyn hyödyntäminen TKI-rahoitushakemusten valmistelussa

Tekoälyn käyttö leviää nopeasti TKI-toiminnassa. Vuoden 2023 lopussa Euroopan tutkimusneuvosto (European Research Council, ERC) (ScienceBusiness, 2023) tiedotti, että tekoälyn hyödyntäminen tunnistetaan työkaluksi rahoitushakemusten kirjoittamisessa. Samalla ERC painotti, että vastuu hakemuksen sisällöstä on aina hakemusta valmistelevilla tutkijoilla. ERC tulee käyttämään hakemusten arvioinnissa tehokkaita keinoja tekstien samankaltaisuuksien tunnistamiseen ja plagioinnin estämiseen. ERC rahoittaa eurooppalaista huipputiedettä ja –tutkimusta, joten rahoittajan näkökulmasta tutkijoiden tiedettä uudistavat ja uusia innovaatioita tuottavat ideat ovat ensisijaisen tärkeitä. (ScienceBusiness, 2023.)

TKI-rahoitushakemuksia valmistellaan yhä enemmän tekoälyn tukemana. Kuten Krista Kurlinkus, How AI is Revolutionizing the Grant Writing Industry -blogistekstissään kirjoittaa (2023) tekoälyn hyödyntäminen TKI-rahoitushakemusten kirjoittamisessa muuttaa hakemusten valmistelua, kun tekoäly voi tuottaa tekstiä kuten kirjoittaja tekisi. Tekoäly on hakemuksia valmistelevan tutkijan, kehittäjän tai asiantuntijan työkalu, joka auttaa hankkeen sisällön ideoinnissa, taustavaikuttimien koostamisessa, kuten erilaisten taustalla vaikuttavien strategioiden tai politiikkojen löytämisessä ja referoinnissa, tai auttaa määrittelemään erilaisia TKI-toiminnan vaikuttavuutta mittaavia indikaattoreita. Tekoälyä voi hyödyntää tiivistelmien muodostamiseen tai hankkeen kuvauksen ja arviointisuunnitelman koostamiseen. Se on oiva apu hakemustekstin editointiin ja oikolukuun. Hakemuksen valmistelija voi hyödyntää tekoälyä työnsä tukena ja keskittyä hakemuksen haastavampiin osiin, kun tekoäly tuottaa tekstiä vaikkapa hakemuksen tiivistelmään, indikaattoreihin ja tarjoaa apua tekstin kohdentamiseen esimerkiksi hakukriteereihin.

Yksi merkittävimmistä huolenaiheista on tekoälyn hyödyntämän tiedon luotettavuus.

Tekoälyä hyödyntäessä on huomioitava mahdolliset haasteet tai haitat. Tekoälyllä ei ole ymmärrystä hankkeiden kokonaiskontekstista, eikä se voi tuottaa henkilökohtaiseen osaamiseen ja aiheen ymmärtämiseen liittyvää joskus hienovaraistakin tietoa, jolla rahoitushakemuksesta tehdään omaleimainen ja muista erottuva (Del Pozo Sanchez 2023).

Tekoälyn käyttö hakemusten valmistelussa nostaa esille myös eettisiä huolenaiheita. Tekoälyn tuottama sisältö pohjautuu aina olemassa olevaan ja saatavilla olevaan tietoon. Tiedon lähteiden tunnistaminen voi olla hankalaa, eikä niitä näin ollen osata tai voida nostaa oikeaoppisesti esille tekstissä. Eettisestä näkökulmasta on myös huomioitava, miten hakemuksessa kerrotaan tekoälyn osuus tekstin tuottamisessa ja rahoitushakemuksen laatimisessa. Hakemuksen valmistelijan on huomioitava miten ja mitä rahoittajalle tulisi kertoa tekoälyn käytöstä hakemuksen laatimisessa. Rahoittajan antamat ohjeet voivat olla epäselviä tai niitä ei ole, jolloin kirjoittajan harkintaan jää miten tekoälyn hyödyntäminen tuodaan esille. Kirjoittajan on muistettava oikeanlainen viittaus ja lähteet sekä TKI-toimintaa ohjaavat eettiset säännöt.

Euroopan komission suurin ja laajin tutkimuksen, kehittämisen ja innovaatioiden rahoitusohjelma vuosille 2021–2027 Horisontti Eurooppa (Horizon Europe funding framework programme) ohjeistaa tekoälyn käytöstä rahoitushakemusten valmistelussa hakemuslomakkeellaan (European Commission, 2021). Hakemuslomakkeella rahoitushakemusten valmistelijoita ohjeistetaan noudattamaan varovaisuutta ja harkintaa käyttäessään tekoälyä hakemuksen laatimisessa. Rahoitushakemusten valmistelijat ovat vastuussa ehdotuksen sisällöstä, myös tekoälytyökalun tuottamasta osuudesta. Tekoälyn tuottama sisältö on tarkistettava huolellisesti hakijoiden toimesta, ja samalla on varmistettava sisällön soveltuvuus ja tarkkuus. Immateriaalioikeuksia koskevia säädöksiä noudatetaan myös tekoälyn tuottaman sisällön osalta. Rahoitushakemusten valmistelijoiden on oltava avoimia siitä, mitä tekoälytyökaluja käytettiin ja miten niitä hyödynnettiin rahoitushakemuksen valmistelussa. (European Commission, 2024h, 31–32.)

Rahoitushakemuksen valmistelussa erityisesti huomioitavia asioita (European Commission, 2024h, 31–32):

- Tekoälytyökalun tuottaman sisällön ja mahdollisten viittausten tarkkuus, pätevyys ja soveltuvuus on tarkastettu ja mahdolliset virheet tai epäjohdonmukaisuudet korjattu.

- Rahoitushakemukseen sisällytetään luettelo lähteistä, joita käytettiin sisällön ja viittausten tuottamiseen, mukaan lukien tekoälytyökalun käyttämät lähteet. Hakemuksen valmistelijoiden on varmistettava viittausten tarkkuus ja viittaamisen asianmukaisuus.

- Plagiointiriski tunnistetaan ja huomioidaan, sillä tekoälytyökalu saattaa toistaa merkittävää tekstiä muista lähteistä. Hakemuksen valmistelijat tarkastavat alkuperäiset lähteet varmistaakseen, ettei plagiointia tapahdu.

- Tekoälytyökalun rajoitukset huomioidaan rahoitushakemuksen valmistelussa, mukaan lukien mahdolliset vinoumat, virheet ja tiedon puutteet, ja otetaan vastuu näistä rajoituksista.

Vinkkejä tekoälyn käyttämiseen rahoitushakemuksen valmistelussa

Sidnae Global Research (2024) tarjoaa neljä vinkkiä tekoälyn hyödyntämiseen rahoitushakemusten kirjoittamisessa:

- Tekoälyn avulla voi lyhentää hakemuksen narratiivia, jos hakemuslomake asettaa merkkimäärälle rajoitteita. Hakemustekstin lyhentäminen voi kirjoittajalle olla haastavaa ja tekoäly voi auttaa lyhentämään tekstiä ja keskittämään tekstin olennaisiin asioihin.

- Tekoälyn avulla voi muokata tekstiä ja tehdä siitä kohderyhmälle sopivamman ja vakuuttavamman muokkaamalla tekstin sävyä kohderyhmälle sopivammaksi ja vetoavammaksi.

- Tekoäly avulla voi muokata tekstistä lyhyemmän ja suoremman. Hakemusten valmistelijat ovat hyviä kirjoittamaan ja joskus tekstistä on liiankin polveilevaa. Tekoäly voi auttaa muokkaamaan ja kirjoittamaan tekstiä, jossa mennään suoraan asiaan ilman turhia kiertoilmaisuja.

- Tekoäly voi auttaa löytämään tekstistäsi ydinasiat ja samalla tuoda esille selkeät puutteet verrattuna rahoitushakuun tai -ohjelmaan. Tekoälyä voi käyttää tekstin tarkistamisessa, että kaikkiin hakukuulutuksessa esitettyihin kysymyksiin tai annettuihin tavoitteisiin on vastattu. Kun ydinasiat ovat tiiviissä muodossa, hakemusta valmisteleva voi tarkastaa onko jotain jäänyt kertomatta tai pitääkö tekstiä muokata vastaamaan paremmin hakukuulutukseen.

Tekoälyn hyödyntämisen haittapuolet on myös syytä pitää mielessä. Yksi merkittävimmistä huolenaiheista on tekoälyn hyödyntämän tiedon luotettavuus. Suuren tietomäärän analysointi tapahtuu tekoälyllä nopeasti, mutta tiedon läpikäyminen sen luottavuuden varmistamiseksi on tärkeää ja joskus haasteellista. Tekoäly voi jossain tapauksissa tulkita olemassa olevaa tietoa väärin, joka johtaa virheisiin, vinoumiin tai huomiotta jättämiseen.

Rahoitushakemusten valmistelussa ja viimeistelyssä on tärkeää säilyttää tekstissä kirjoittajien persoonallinen ote ja oman käden jälki. Organisaation arvot ja tavoitteet tulee näkyä tekstissä, vaikka tekoälyä olisi hyödynnetty kirjoittamisprosessin apuna. Persoonallinen ote ja organisaation näkyminen tekevät rahoitushakemuksesta erottuvamman ja lukijalle mieleenpainuvamman.

Rahoitushakemusten valmistelussa on huolehdittava, että sensitiivinen tai omistusoikeudellinen tieto säilytetään oikein. Tekoäly auttaa luomaan sisältöä nopeasti, ja arkaluonteisten tietojen suojaaminen luvattomalta käytöltä tai paljastamiselta on ratkaisevan tärkeää. Vaikka tekoälytyökalujen hyödyntäminen rahoitushakemusten valmistelussa ja kirjoittamisessa on arvokas apu, on hakemusten valmistelijoiden ymmärrettävä tekoälyn hyödyntämiseen liittyvät riskit, otettava vastuu hakemuksen sisällöstä ja varmistuttava siitä, miten riskien toteutuminen voidaan välttää. (Sidnae Global Research, 2024.)